모델 튜닝은 모델의 성능을 최대한 향상시키기 위해 사용되는 과정이다.

주로 두가지 방법이 있다.

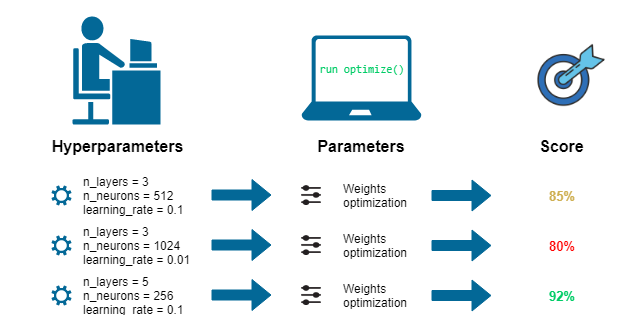

1. 하이퍼파라미터 튜닝: 모델의 성능을 향상시키기 위해 모델의 하이퍼파라미터를 "미세하게 조정하는" 과정을 의미할 수 있습니다. 이는 위에서 설명한 하이퍼파라미터 튜닝과 동일한 개념입니다. 이 경우, 학습률(learning rate), 에포크 수(epochs), 배치 크기(batch size) 등과 같은 하이퍼파라미터를 조정한다.

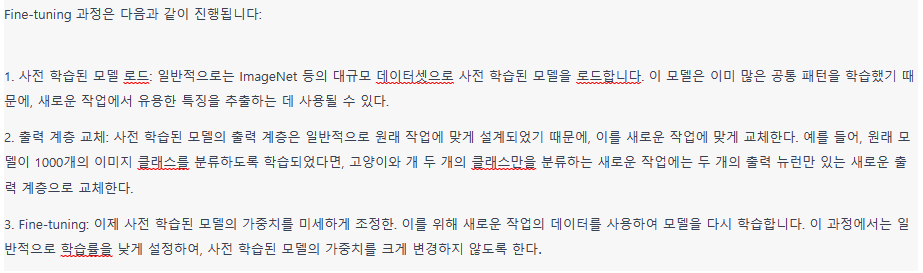

2. 전이 학습(Transfer Learning)에서의 Fine-tuning: 이미 학습된 모델(pre-trained model), 특히 딥러닝 모델을 새로운 작업에 맞게 "미세하게 조정하는" 과정을 의미하기도 합니다. 이 경우, 모델의 가중치를 미세하게 조정하여 모델을 새로운 작업에 맞게 최적화한. 이 방법은 새로운 작업에 대한 데이터가 부족할 때 특히 유용하다.

하이퍼파라미터 튜닝과 Fine-tuning은 각각 모델의 다른 측면을 개선하는 방법이므로, 두 방법은 서로 보완적이며 종종 함께 사용된다. 예를 들어, 사전 학습된 모델을 Fine-tuning한 후, 이 모델의 하이퍼파라미터를 튜닝하여 최종적으로 모델의 성능을 최적화하는 방식이 흔히 사용된다.

◆ 하이퍼파라미터 튜닝

AI 모델의 하이퍼파라미터 튜닝은 모델의 성능을 최적화하는 중요한 과정이다. 하이퍼파라미터는 모델 학습에 영향을 미치는, 그러나 데이터로부터 학습되지 않는 파라미터들을 말한다. 대표적인 하이퍼파라미터에는 학습률(learning rate), 배치 크기(batch size), 에포크 수(epochs), 최적화 알고리즘(optimizer), 등이 있다.

학습률(learning rate): 이는 모델이 데이터로부터 배우는 속도를 제어한다. 너무 높은 학습률은 모델이 최적의 솔루션을 너무 빨리 지나쳐 버릴 수 있다. 반면에 너무 낮은 학습률은 학습 속도가 너무 느려져, 충분한 학습이 이루어지지 않을 수 있다.

배치 크기(batch size): 배치 크기는 한 번의 학습 단계에서 모델이 볼 데이터의 수를 의미한다. 큰 배치 크기는 학습 과정을 안정화시키고, GPU 메모리를 효율적으로 활용할 수 있지만, 학습 시간이 길어질 수 있다. 반면에 작은 배치 크기는 더 빠른 학습을 가능하게 하지만, 학습 과정이 불안정해질 수 있다.

에포크 수(epochs): 에포크는 전체 학습 데이터셋에 대한 학습의 완전한 주기를 의미한다. 너무 적은 에포크 수는 모델이 충분히 학습되지 않을 수 있다. 반면에 너무 많은 에포크 수는 모델이 학습 데이터에 과적합될 위험이 있다.

이러한 하이퍼파라미터들은 모델의 성능에 크게 영향을 미치므로, 적절한 값을 찾는 것이 중요한다. 그러나 최적의 하이퍼파라미터 값은 문제에 따라 다르므로, 주로 경험적으로 탐색하는 과정을 거치게 된다. 그리드 서치(grid search), 랜덤 서치(random search), 베이지안 최적화(Bayesian optimization) 등의 방법을 사용하여 시스템적으로 하이퍼파라미터 튜닝을 수행할 수도 있다.

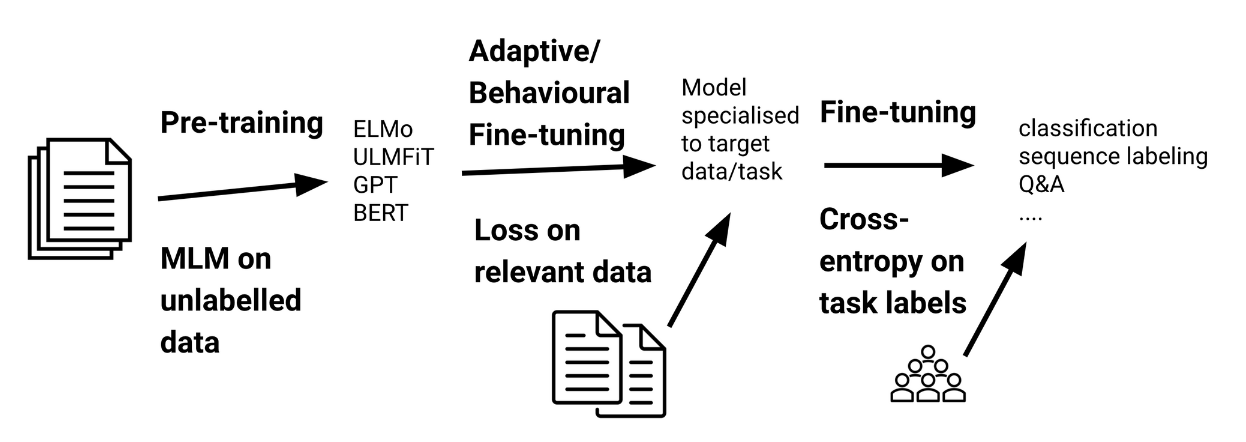

◆ Fine-Tuning

전이 학습(Transfer Learning)에서의 Fine-tuning은 대량의 데이터에 대해 사전에 학습된 모델을 새로운 작업에 맞게 미세하게 조정하는 것을 의미한다.

이 과정은 주로 딥러닝 모델, 특히 컨볼루션 신경망(Convolutional Neural Networks, CNN) 또는 트랜스포머(Transformer) 모델에서 자주 사용된다. 이 모델들은 이미지 분류, 객체 탐지, 자연어 처리 등의 다양한 작업에 대해 대량의 데이터(예: ImageNet, Wikipedia)에 대해 사전에 학습되어 있다

이렇게 하면, 사전 학습된 모델이 이미 학습한 특징을 활용하여 새로운 작업을 빠르게 학습하고, 적은 양의 데이터로도 높은 성능을 달성할 수 있다. 이는 특히 새로운 작업에 대한 데이터가 부족한 경우에 유용하다.

'메거진' 카테고리의 다른 글

| TMS 운송영역별, 운송유형별, 운송방식별 분류 (0) | 2024.05.24 |

|---|---|

| 인테리어 공사 AI를 활용한 자동견적시스템 구축 (연재-모델배포 6/6) (0) | 2023.07.18 |

| 인테리어 공사 AI를 활용한 자동견적시스템 구축 (연재-모델검증 및 테스트 4/6) (0) | 2023.07.18 |

| 인테리어 공사 AI를 활용한 자동견적시스템 구축 (연재-모델정의 및 학습 3/6) (0) | 2023.07.18 |

| 인테리어 공사 AI를 활용한 자동견적시스템 구축 (연재-데이터 전처리 2/6) (0) | 2023.07.18 |